Los métodos científicos fundamentales

| Faculté | Faculté des sciences de la société |

|---|---|

| Département | Département de science politique et relations internationales |

| Professeur(s) | Marco Giugni[1] |

| Cours | Introducción a los métodos de la ciencia política |

Lectures

Desafíos a la inferencia empírica en la ciencia política[modifier | modifier le wikicode]

Definición[modifier | modifier le wikicode]

- inferir: sacar conclusiones generales a partir de hechos, datos observacionales y datos experimentales. Existe un contexto de inferencia empírica cuando se quiere establecer vínculos y relaciones entre factores explicativos y explicar sobre la base de datos concretos o empíricos.

- causalidad: Cómo juzgar las relaciones causa-efecto es un tema central, especialmente en la metodología.

- empírico: sacar conclusiones generales de la evidencia empírica.

Los tres desafíos[modifier | modifier le wikicode]

Multi-causalidad[modifier | modifier le wikicode]

- casi todo tiene un impacto: está determinado por una multiplicidad de causas posibles; por ejemplo, el comportamiento de voto político no está determinado por una causa, hay varios factores. Un ejemplo es el nivel de educación, pero hay otros factores contextuales involucrados: género, posición en el aula.

- cada fenómeno tiene varias causas: es difícil defender una posición que dice que un fenómeno determinado tiene una sola causa. Cuando hay varios factores, esto complica la tarea.

Condicionalidad del contexto[modifier | modifier le wikicode]

En relación con la evaluación comparativa, existe un canal institucional que permite a los ciudadanos participar, lo que ayuda a explicar por qué la gente participa en Suiza, pero no en otros países donde no existe la democracia directa. Las causas de un fenómeno pueden variar de un contexto a otro. El vínculo entre clase y votación muestra que hay condicionalidad en el contexto y modifica la relación que puede existir entre dos factores que pueden ser estudiados. Hay efectos variables en todo el contexto.

- El efecto de casi todo depende de casi todo lo demás.

- Los efectos de cada causa tienden a variar de un contexto a otro.

Endogeneidad[modifier | modifier le wikicode]

Las causas y los efectos se influyen mutuamente; éste es el mayor problema en los estudios empíricos, especialmente los que siguen el enfoque de la observación. Por ejemplo: el interés político influye en la participación (fuerte correlación entre interés (independiente) y participación (dependiente)). El problema es que la causalidad puede invertirse: "lo que quiero explicar puede explicar lo que se supone que explica lo que quería explicar".

Es la dificultad de distinguir entre "lo que quiero explicar" y el factor que explica este fenómeno. La causa se convierte en un efecto y viceversa.

- Casi todo causa casi todo lo demás. Las causas y los efectos se influyen mutuamente.

- A menudo es difícil decir en qué dirección va la causalidad que se quiere aplicar.

Le concept de cause[modifier | modifier le wikicode]

Determinante de la relación causal[modifier | modifier le wikicode]

En el enfoque científico de las ciencias sociales, el objetivo es determinar las relaciones causales.

"Si C (causa), entonces E (efecto)"[modifier | modifier le wikicode]

No es suficiente! La relación entre C y E puede a veces o siempre valer la pena. Ejemplo - Necesitamos ser un poco más específicos. Si decimos que si hay un alto nivel de educación, podemos decir que hay un mayor nivel de participación. Se argumenta que si hay C entonces hay E, no hay univocidad de la relación mientras que la relación de causa y efecto debe ser inequívoca.

"Si C, entonces (y sólo entonces) siempre E"[modifier | modifier le wikicode]

En este caso están las cuatro características de la relación causa-efecto:

- Condicionalidad: efecto a condición de que exista una causa.

- Sucesión: primero la causa, luego el efecto.

- Consistencia: "Siempre que la causa está presente, también se observa el efecto.

- Univocidad: el vínculo es único.

Se introducen elementos importantes para definir qué es una causa. - enfoque todavía no es suficiente! Ejemplo: si el nivel de educación es alto, entonces y sólo entonces siempre hay una mayor participación.

Sin embargo, según algunos, en la epistemología de la ciencia, falta el elemento que consiste en decir que debe haber un vínculo genético, un vínculo en la producción del efecto debido a la causa.

"Si C, entonces (y sólo entonces) E siempre producido por C"[modifier | modifier le wikicode]

VERDADERO: Un efecto dado no sólo debe estar correlacionado con una causa, sino que el efecto debe ser producido y generado por esa causa. La distinción es más filosófica que sustancial.

Definición de lo que es una causa[modifier | modifier le wikicode]

- es generado por , por lo que no basta con observar una covarianza entre una causa y un efecto, sino que también es necesario, para hablar de causa, que el efecto sea generado por la causa.

- La causa debe producir el efecto. (por ejemplo, si tienes un alto nivel de educación, esto genera participación en la política).

Básicamente, en el contexto del pensamiento causal, pertenece sólo al nivel teórico. Cuando hablamos de causa, estamos en un nivel puramente teórico y no empírico. Por lo tanto, nunca se puede decir que empíricamente, una variación de produce una variación de .

Nunca lograremos establecer relaciones de causa y efecto a nivel teórico, sólo podemos hacerlo a nivel empírico.

Si observamos empíricamente, sobre la base de los datos, que una variación de y seguido regularmente por una variación de , podemos decir que hay un elemento de corroboración empírica de una hipótesis causal. Hay que distinguir entre el nivel teórico y el nivel causal, que es el nivel empírico al que sólo se puede llegar mediante el estudio de las covariaciones.

En otras palabras, si observamos que una variación de y seguido regularmente por una variación de , hay un elemento de corroboración, pero cualquier otra causa posible debe ser eliminada. Empíricamente, la tarea es decir que queremos encontrar una covariable, pero dado que hay multi-causalidad, ¿cómo podemos asegurarnos de que esta covariable realmente existe y afirmar que tenemos un elemento de corroboración empírica de la suposición de la relación causa-efecto?

Corrosión empírica de una relación causal[modifier | modifier le wikicode]

Si observamos empíricamente que una variación de es seguido regularmente por una variación de manteniendo a todos los demás constantes (otras causas y factores explicativos) hay un fuerte elemento de corroboración científica de la hipótesis de que es la causa de .

En la investigación empírica, nunca podríamos hablar de causa y efecto; debemos tener en cuenta que la relación causa-efecto permanece en la esfera de la teoría, empíricamente sólo podemos acercarnos bajo ciertas condiciones, encontrando la covarianza mientras mantenemos constantes los otros factores.

- covarianza entre variables dependientes (depende) e independientes (causa, no depende de nada más): ambas deben variar.

- dirección causal: es necesario dar una dirección a la causalidad, el problema de la endogeneidad.

- Imposibilidad lógica: si se tiene una teoría de la clase social que influye en la orientación política, es obvio que es la clase la que determina. La causalidad no puede ser revertida.

Hay que recordar que en las ciencias sociales queremos avanzar hacia una idea de explicación causal. Sin embargo, esto nunca puede hacerse, porque en el nivel epistemológico la idea de causa y efecto está en el nivel teórico. A nivel empírico, sólo podemos hablar de "variación", pero bajo ciertas condiciones podemos corroborar, es decir, verificar empíricamente una relación causal.

Corrosión empírica de una relación causal[modifier | modifier le wikicode]

Hay tres condiciones que deben cumplirse para verificar empíricamente una relación causal.

Covariable entre variables independientes y dependientes[modifier | modifier le wikicode]

- variación de la variable independiente: ésta es la causa () ej: educación

- variación de la variable dependiente: depende de , es el efecto; por ejemplo, la participación - ¡lo que se supone que se debe explicar debe variar! También la variable independiente!

A lo sumo, la relación causal teórica puede ser corroborada empíricamente.

Dirección causal[modifier | modifier le wikicode]

"No puedo decir si esta es la que determina el ou a lo contrario". Hay tres maneras de determinar la dirección de la causa y de acercarse al ideal teórico para definir una relación de causa y efecto.

- manipulación de la variable independiente: análisis experimental, estos son diferentes métodos científicos fundamentales.

- sucesión temporal: hay algunas variables que lógicamente preceden a otras variables. Por ejemplo, la socialización primaria precede (influye) en el comportamiento electoral de una persona de 30 años. (el problema de la endogeneidad se resuelve en este caso). En algunos casos hay sucesiones evidentes. A nivel empírico, esto es importante para determinar una dirección hacia la causalidad.

- imposibilidad lógica: la clase social no determina la orientación política. Hay algunos factores que no pueden depender de otros factores. Existen imposibilidades lógicas que permiten establecer la relación causa-efecto.

Control de variables ajenas[modifier | modifier le wikicode]

Empíricamente, se podría decir que el nivel de participación política varía en función de varias variables. Este es el objetivo de controlar las variables extranjeras. Se puede decir que el 90% de lo que hacemos en la investigación en ciencias sociales es para asegurarnos de que podemos controlar el efecto de los factores explicativos que no nos interesan. Elemento determinante: control de las otras variables.

- aplicación de la regla "ceteris paribus": la relación causa-efecto puede determinarse sabiendo que el resto no está involucrado, siendo todas las demás cosas iguales. Existe una relación entre un fenómeno dado y otro fenómeno, en igualdad de condiciones, es decir, que debemos garantizar que todos los demás factores puedan ser controlados o, en otras palabras, que sean constantes.

- depende de la lógica del diseño de la investigación: es mi manera de controlar el papel de otras causas potenciales que dependen del diseño del modelo de investigación. Depende de la lógica del diseño de la investigación; diseño de la investigación observacional. La manera de sortear este problema es diferente dependiendo del modelo de investigación. El objetivo es controlar el efecto de otras causas potenciales cuyo efecto queremos mostrar.

Relación causal falsa[modifier | modifier le wikicode]

Definición[modifier | modifier le wikicode]

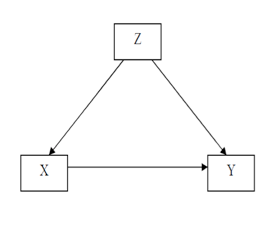

Relación causal falsa (espiritista): es una relación causal aparente, pero inexistente, pensábamos que habíamos encontrado una relación causal, pero finalmente no hubo relaciones causales, sino sólo una covariable. Es una covariable entre dos variables ( ; ) que no resulte de una relación causal entre y , pero depende del hecho de que y están influenciados por una tercera variable . La variación de produce la variación simultánea de y

sin que exista una relación causal entre los dos.

Siempre existe el peligro de que una relación observada no sea indicativa de una relación causal.

Ejemplo de una relación causal falsa[modifier | modifier le wikicode]

Ejemplo 1[modifier | modifier le wikicode]

La intención de voto está influenciada por varios factores (edad, género, educación, clase social, orientación política de la familia, etc.).

Podemos encontrar un vínculo entre la educación () y votar (), pero al final es de clase social ()

que determina a ambos. Por lo tanto, deben introducirse variables de control! De lo contrario, sólo puede ser una covariable sin relación causal.

Uso de la televisión por dos candidatos ()

en las elecciones presidenciales para comunicar su programa.

Queremos explicar el voto (),pero el voto está influenciado por varios factores que juegan un papel como la educación, pero es la clase social la que genera una multi-causalidad. La idea es ver el efecto de la exposición a la campaña de televisión en los votantes. Por lo tanto, existe una relación muy fuerte entre y Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} . ¿Podemos confiar en la covarianza entre Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} y Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} ?

Votantes que siguieron la campaña por televisión (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} ) votó en mayor número por uno de los dos candidatos (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} ). Se podría decir que la exposición a la campaña produce el voto, pero hay que tener en cuenta que: los votantes mayores (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} )

ver la televisión más a menudo, por lo que la edad influye en la votación (viejo a la derecha, joven a la izquierda).

La edad (Z) influye tanto en la exposición a la campaña como en la televisión (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} ), los mayores se quedan en casa y ven la televisión, y votan por uno de los dos candidatos (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} ).

Por lo tanto, la covarianza entre Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} y Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} no se verifica, porque la variable Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} influye en las otras dos variables al mismo tiempo. Para ello, se debe introducir una variable de control.

Examinaremos los factores que explican de manera plausible lo que queremos explicar.

Ejemplo 2[modifier | modifier le wikicode]

Por ejemplo, si nos interesa el número de frigoríficos y el nivel de democracia, es irrelevante reivindicar un vínculo entre ambos. Sin embargo, podría explicarse que una tercera variable, que sería el grado de urbanización, genera democracia según ciertas teorías y al mismo tiempo aumenta el número de refrigeradores. Por lo tanto, la covariable no es una relación causa-efecto, porque hay una tercera variable que influye en ambas y es una relación causa-efecto.

Ejemplo 3[modifier | modifier le wikicode]

Si la participación política (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} ) se explica por el compromiso asociativo (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} ) se podría pensar que esta relación es falaz por el hecho de que hay otra variable que influye tanto en la participación como en el compromiso asociativo. Esta variable (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} ) podría ser la participación política. Una vez más, existe una relación engañosa; sería un error concluir a partir de la mera observación de esta relación que existe una relación causal entre Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} y Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} porque no controlamos el efecto de otra variable.

Dos maneras de controlar empíricamente una afirmación causal[modifier | modifier le wikicode]

En el caso de problemas relacionados con relaciones causales engañosas (multicausalidad y endogeneidad), hay dos maneras de controlar empíricamente la alegación causal.

Análisis de covarianza (datos de observación)[modifier | modifier le wikicode]

- control: transformación de variables ajenas (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} ) en constantes, por lo que no tiene efectos, porque no hay covarianza, no cambia. Debemos tener en cuenta las posibilidades de relaciones engañosas (por ejemplo, buscamos entre todos los que van a la universidad en la clase social más alta, y luego analizamos su voto; por lo tanto, la clase no jugará un papel en el análisis). Este control se puede hacer manualmente.

- depuración: control estadístico. Hacemos un modelo estadístico, introducimos que la variable Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} , nos interesa, introducimos variables con una relación fuerte, luego introducimos las otras variables de control, y si todavía encontramos un efecto entre Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle X} y Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Y} , significa que la relación no era engañosa. Esto es hecho por una computadora que calcula las relaciones entre todas las variables y también considera todas las relaciones de co-variación. Al final determina si hay una correlación falsa o no. El control estadístico es una forma de controlar las variables y permite probar empíricamente la relación causa-efecto.

Experimento (datos experimentales)[modifier | modifier le wikicode]

Es la implementación de un método experimental. En el análisis de covarianza actuamos una vez que tenemos los datos, es decir, manipulamos los datos a priori desde el diseño de la investigación, mientras que en el método experimental actuamos antes (¿cómo producimos los datos?). El método experimental se utiliza para evitar una relación engañosa, una muestra se divide en dos grupos y los individuos se seleccionan al azar. De acuerdo con la ley de los grandes números, se puede demostrar que los dos grupos son similares, por lo que la única diferencia será la variable independiente.

Conclusión: es una reflexión en torno a la causalidad; se ha dicho que la cuestión de la causalidad permanece en el nivel teórico, sólo podemos intentar acercarnos a este ideal. Hay que buscar una correlación, pero hay que descartar hipótesis (contra variables), si no lo haces puedes caer en una relación causal engañosa.

Covariación: puede ser cercana a una relación causal, pero es el efecto de una Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} (variable no observada) que influye en lo que queremos explicar (dependiente) y en lo que explicaría lo que queremos explicar (independiente). Una variable influye en las otras dos variables al mismo tiempo, también existe la posibilidad de una interacción entre las variables explicativas.

¿Cómo controlar las variables para evitar caer en una relación engañosa? Hay dos maneras:

- análisis de covarianza: observamos (datos observacionales) después de tener los datos.

- control: haremos una constante de una variable ajena, cuando tengamos una relación asumida entre dos variables que se hace falaz, porque hay una tercera variable, tomamos una parte de los individuos que corresponde a la segunda variable, por ejemplo, tomamos a personas de la misma edad, para la relación conductual entre la exposición a la televisión y el voto. Así que comprobamos este valor, lo hicimos constante.

- depuración: es un control estadístico. Depuración para todas las variables.

- análisis experimental: establecemos un diseño de investigación que evita la existencia de variables Z que puedan afectar a nuestro análisis.

Cuatro métodos científicos fundamentales según Arend Lipjhart[modifier | modifier le wikicode]

Se pueden mencionar tres o incluso cuatro métodos:

- Método experimental (diferente a los demás)

- Método estadístico

- Método comparativo

- Estudio de caso

Estos son los tres métodos fundamentales que permiten controlar las variables también conocidas como "factores explicativos adicionales". El objetivo es probar hipótesis y descartar algunas de ellas en competencia con otras.

Los tres primeros métodos finalmente tienen el objetivo principal de buscar relaciones de causa y efecto, y buscan eliminar el ruido producido por Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} que podrían producir una relación engañosa, tienen el mismo propósito, pero lo persiguen de una manera diferente. Las tres establecen proposiciones empíricas generales bajo el control de todas las demás variables (Échec de l’analyse (MathML avec SVG ou PNG en secours (recommandé pour les navigateurs modernes et les outils d’accessibilité) : réponse non valide(« Math extension cannot connect to Restbase. ») du serveur « https://en.wikipedia.org/api/rest_v1/ » :): {\displaystyle Z} ). Quieren acercarse a la relación teórica de causa y efecto entre un fenómeno observado y las causas potenciales, hay diferentes grados de éxito, hemos visto que el método experimental y el que está más cerca de él, sobre los diferentes factores explicativos. La idea es llegar a una corroboración empírica de las declaraciones causales.

Método experimental[modifier | modifier le wikicode]

Principios[modifier | modifier le wikicode]

- Asignación aleatoria: seleccionados al azar, todos los individuos tienen la misma probabilidad de estar en el grupo experimental o en el grupo de control de sujetos (en los grupos de control experimental y no experimental). Esta idea nació del principio de la ley de los grandes números: se supone que la variable aleatoria excluye cualquier otra explicación.

- Manipulación de la variable independiente (tratamiento), ¿cómo son los grupos iguales? el investigador, en algún momento, introduce una entrada en uno de los dos grupos.

Separamos dos grupos para que los dos grupos sean iguales en todas las dimensiones excepto en una, que es sobre la que queremos probar el efecto. Seleccionar a una persona y asignarla al azar hace que los dos grupos sean similares. Si, posteriormente, se introduce un tratamiento en uno de los dos grupos y se observa un cambio que no está en el grupo de control, puede haber un efecto causal que entra en una reflexión de causa y efecto. Por lo tanto, puede concluirse que existe un efecto causal en la variable introducida.

Tipos de experimentos[modifier | modifier le wikicode]

- En el laboratorio (experimento de laboratorio): se trata de experimentos realizados en laboratorios y luego los individuos se dividen en grupos a los que se aplican estímulos para llegar a un hallazgo de efecto o no efecto. Sin embargo, los individuos son sacados de sus condiciones naturales que pueden conducir a resultados relacionados con la artificialidad de las condiciones experimentales.

- En el experimento de campo: contexto natural, puede haber otros factores involucrados. Se trata de experimentos que se han aplicado en la ciencia política. Los principios siguen siendo los mismos con una distribución aleatoria de los sujetos en dos grupos; la variable independiente se manipula y luego se determina si hubo un efecto del tratamiento en el grupo experimental y no en el grupo control. De este modo, se puede evitar la crítica de la artificialidad de los experimentos de laboratorio.

- Sorteo cuasi-experimental (cuasi-experimental): este sorteo tiene en cuenta que el investigador manipula la variable independiente, pero no hay asignaciones aleatorias de sujetos a un grupo experimental y a un grupo de control. Si hacemos esto, es porque no podemos distribuir al azar en dos grupos, nos vemos obligados a tomar los grupos que realmente existen. En otras palabras, el investigador controla el tratamiento, pero no puede asignar sujetos al azar. A veces, cuando estamos en el campo, es difícil hacer las cosas de manera diferente. Normalmente este es el método que usamos, porque hay un factor que no podemos controlar.

Ejemplo[modifier | modifier le wikicode]

Un psicosociólogo quería probar los efectos de los objetivos colectivos en las relaciones interpersonales. Quería ver hasta qué punto, cuando a un grupo de personas se les dice que hay un objetivo, desaparecen los estereotipos negativos contradictorios. Es una experiencia inmediata en condiciones naturales. Dejó que los niños interactuaran entre sí, los niños cooperaron entre sí; el investigador trató de crear una identidad colectiva y dividió al grupo en dos al azar. Los hizo jugar al fútbol; vimos la aparición de rivalidades e incluso estereotipos negativos hacia el otro equipo. Luego volvió a reunir al grupo y redefinió un objetivo común que requiere cooperación. Posteriormente, observó que esos conflictos, estereotipos negativos y hostilidades se transformaron en una verdadera cooperación.

Método estadístico[modifier | modifier le wikicode]

No podemos hacer un dibujo de investigación que a priori nos permita comprobar si existen relaciones de correlación, pero debemos hacerlo después del hecho.

- manipulación conceptual (matemática) de datos observados empíricamente: tenemos datos observacionales o intentamos controlarlos mediante control estadístico, con correlaciones parciales. Se hace una distinción entre datos experimentales y observacionales.

- correlaciones parciales: correlación entre dos variables una vez que se ha salido del análisis, es decir, controlando el efecto de otras variables que podrían influir en lo que se quiere explicar. En otras palabras, significa hacer las otras Zs como si fueran constantes después de un proceso de depuración. Es una lógica de control de variables: controlamos las variables que pueden influir en lo que nos gustaría explicar. En el ejemplo de la votación, cualquier cosa que pueda explicar el voto debe ser tomada en consideración, especialmente si se puede asumir que este factor externo puede influir tanto en el voto como en la variable independiente (exposición mediática). De esta manera podemos saber si nos estamos acercando a un efecto causal.

Lo importante es ir más allá de un simple análisis bivariado; es necesario avanzar hacia un análisis multivariado en el que se introduzcan otras variables en el modelo explicativo.

Método comparativo[modifier | modifier le wikicode]

Toda la investigación en ciencias sociales es por naturaleza comparativa. Siempre comparamos algo implícita o explícitamente. Uno puede preguntarse acerca de los objetivos de la comparación. Hemos visto que los objetivos de cualquier método científico intentan establecer proposiciones empíricas generales controlando todas las demás variables, pero según algunas, como Tilly, hay cuatro objetivos de comparación, es decir, la comparación de unidades de observación.

Los objetivos de la comparación según Charles Tilly son:

- Individualización (individualizing): el objetivo es poner de relieve las características de una unidad de análisis determinada sobre un fenómeno determinado; la idea es encontrar comparaciones, dar especificidad a un caso concreto: en los estudios comparativos de políticas, el caso es el país, se comparan los países; el objetivo es, por ejemplo, mostrar ciertas características del sistema político suizo en relación con otros países. La democracia directa determina los valores políticos; la democracia directa suiza puede compararse con los países que no la tienen. Podemos analizar el impacto de esta característica en las personas. Caracterizar, individualizar, hacer más específicas las características de un país en relación con otro.

- Generalizar (generalizing): no se compara con individualizar, sino con generalizar, se incluye el mayor número de casos, se establecen propuestas empíricas generales. Para algunos, la generalización es uno de los dos objetivos principales del método comparativo. Estudiamos los comportamientos que comparamos, queremos ver si las configuraciones y efectos que encontramos en un contexto se encuentran en otro contexto.

- Búsqueda de variaciones sistemáticas (variation-finding): el objetivo es buscar variaciones sistemáticas y probar una teoría descartando las teorías que compiten con la que se quiere destacar. Según Tilly, esta es la mejor manera de comparar. Intentamos probar una hipótesis causal, así que descartamos las hipótesis rivales.

- Globalización (encompassing): el objetivo es globalizar (enfoque sistémico) incluimos a todos los países del mundo, o a todas las unidades de comparación posibles. La idea es que si se elimina una de estas unidades de comparación, se modifica todo el sistema. Para el profesor Giugni, este no es un enfoque comparativo, porque no hay comparación.

Los objetivos de la comparación son diferentes; actuar en la selección de casos es comparar.

Estrategias de comparación para buscar variaciones sistemáticas (Przeworski y Teune) Se puede distinguir entre dos estrategias de comparación, que son lógicas y formas de proceder metodológicamente en la elección de los casos. Estas son formas de abordar la cuestión de la causalidad cuando se dispone de datos observacionales. Se hace una distinción entre dos diseños de investigación comparativa, a saber, la comparación por caso analógico (similar) y por caso de contraste (diferente). Cada una de las opciones tiene sus ventajas y desventajas.

- Comparación entre casos contrastantes (most different systems design): elegimos los casos que son lo más diferentes posible.

- Comparación entre casos análogos (most similar systems design): tiene como objetivo controlar todas las variables excepto la que se desea analizar (ejemplo Francia - Suiza).

Stuart Mill reflexionó sobre cómo analizar este vínculo causal. Al seleccionar diferentes casos para lograr este ideal, buscamos la relación de causa y efecto. Pero no estamos en el contexto del control estadístico. En nuestro caso, a través de la selección de casos, intentamos acercarnos a este ideal.

Stuart Mill distingue entre dos casos:

- The method of agreement (the most different system design): la lógica es elegir países muy diferentes, pero que son similares en un factor clave. Hay X en todas partes. Luego observamos Y, luego hay una similitud en la variable Y que queremos explicar. La lógica es decir que estamos buscando países donde encontramos el mismo fenómeno, que es el que queremos demostrar. Observamos que lo que sucede es que cada vez que hay X encontramos Y. En ese momento, es producido por X porque no puede ser producido por otra cosa, porque los otros factores de los países son diferentes, no se encuentra en ninguna otra parte. La lógica es elegir casos muy diferentes sobre la mayoría de los factores en los que puedes pensar y luego verás si hay una copresencia de la variable que quieres explicar y la que explica.

- The method of difference (the most similar system design): estamos buscando países que sean lo más parecidos posible. Se puede distinguir entre casos positivos y negativos. Buscaremos casos que tengan el factor A, B y C y casos negativos que también tengan A, B y C. En los casos positivos hay un factor presente que no está presente en los casos negativos. Por lo tanto, la votación está presente cuando X está presente y ausente cuando X está ausente. La conclusión es que X es la causa del efecto Y, porque la presencia de al menos Y no puede haber sido producida por A, B y C. Hemos hecho A, B y C constantes.

Ejemplo - most different system design: hay tres casos (1, 2, n); un caso puede ser de individuos, países, etc. Tenemos una serie de cualidades para estos casos. Estas son características de diferentes países (desempleo, desarrollo), X es la variable independiente y queremos explicar Y. En esta lógica de comparación, los casos son muy diferentes, pero sólo son similares en una propiedad. Así que esta variable explica el factor, porque es el único factor común. En la Tabla 2 tenemos casos positivos y negativos; estos casos son perfectamente similares sobre tantos atributos, propiedades y variables como sea posible, pero hay una diferencia crucial en lo que se supone que explica lo que queremos explicar. Hay un factor que no está presente. En un caso hay Y en el otro paso; la diferencia se atribuye a la variable que no lo es en ambos casos. Este método trata de aproximar el enfoque experimental, porque se hace de manera que los dos grupos estén lo más cerca posible (similar a a, b, c), pero difieren con la variable independiente, el diseño de sistema más similar. El profesor Giugni lo prefiere así, porque se acerca al ideal de la experimentación. Un ejemplo es estudiar a los estudiantes que asisten al curso durante dos años y cambiar las diapositivas que se dan. Luego, comparamos el resultado final (la puntuación media) en ambos casos.

Ejemplo - most similar system design : Comparo países que son similares (Francia y Suiza), y quiero demostrar que la represión policial francesa es más fuerte, es el único factor que difiere entre dos países. Entonces vemos que la radicalización de los movimientos sociales es más fuerte en Francia. El problema es que la "A", es decir, los factores que son similares entre los dos países, nunca son iguales, sino sólo similares (este problema sólo se puede encontrar con el método de diseño de investigación más similar, por lo que hay investigadores que prefieren el otro enfoque, en el que sólo es necesario encontrar las diferencias), sólo podemos acercarnos al ideal. Además, encontramos el problema de la endogeneidad, es decir, saber qué factor influye en el otro.

Estudio de caso[modifier | modifier le wikicode]

Es un método más cualitativo, se diferencia de los otros tres métodos en que están más orientados a la investigación cuantitativa-positivista. Hay algunas distinciones hechas por Arend Lipihart, hay una especie de división, una distinción entre los datos experimentales y, por otro lado, los datos de observación.

Mientras que el método experimental se basa en la idea de un gran número, el método comparativo un número de casos que pueden variar, el estudio de caso se basa en un solo caso. Sin embargo, es posible considerar un estudio de caso que puede cubrir más de un caso, ya que la frontera es a veces flexible.

El estudio de caso es sólo el estudio de un caso, no tiene ninguna comparación. Un caso puede ser muchas cosas como una fiesta, una persona o un país. Tratamos de estudiar un caso en particular en profundidad, pero no de una manera extensa como los otros tres métodos que no estudian los casos tan a fondo.

En otras palabras, la gran ventaja del estudio de caso es que se puede profundizar mucho más en el conocimiento del caso. Un estudio de caso es por definición intensivo, mientras que el estudio cuantitativo es extenso. Un método se basa en normas con la idea de generalizar, mientras que el otro se basa en una interpretación en profundidad de un caso específico.

Si el método estadístico pretende generalizar, el estudio de caso por definición no permite la generalización, el objetivo es otro. Existen diferentes estudios de caso y diferentes maneras de llevar a cabo un estudio de caso. Podemos mencionar 6 variantes:

- las dos primeras se centran en el caso específico.

- las otras cuatro modalidades tienen el objetivo de crear o generar una teoría.

El estudio de caso puede ser utilizado para lograr diferentes objetivos, por un lado uno quiere conocer mejor una situación particular de una manera descriptiva, por otro lado uno puede estudiar varios casos permitiendo generar una teoría a largo plazo.

Según Arend Lipihart, el propósito de la investigación es probar y verificar una teoría, así como generalizar los resultados.

Estos dos casos no quieren crear hipótesis, la idea es arrojar luz sobre algo en relación con un caso:

- ateórico: no hay teoría, es puramente descriptivo. Es una investigación exploratoria, por ejemplo, el estudio de una nueva organización, sólo queremos conocerla y describirla, en cuyo caso no podemos generalizar los resultados, porque están relacionados con un caso particular estudiado. Se utiliza en situaciones o casos que nunca se han estudiado antes.

- interpretativo: utilizamos las propuestas teóricas que existen en la literatura, en este enfoque cualitativo el papel de la literatura es menos importante, aplicamos una generalización existente a un caso dado, aquí el caso se refiere a un caso específico, sin la voluntad de crear una teoría como el ateo. El objetivo no es confirmarlo o negarlo, sino sólo aplicarlo. Las propuestas o teorías existentes se utilizan y aplican a un caso; las generalizaciones existentes se aplican a él para ver si la generalización se basa en ese caso específico. Una situación particular se interpreta a la luz de una teoría existente.

Los siguientes cuatro quieren crear una teoría o sacar algo de los casos. Su objetivo es crear o generar teorías o hipótesis:

- generar hipótesis: queremos crear hipótesis donde no las hay. Estudio un caso no sólo porque me interesa, sino porque quiero formular hipótesis que probaré en otro lugar. Por ejemplo: una organización que está involucrada en la política. Estudiamos una situación determinada porque queremos hipótesis que no podemos encontrar en otra parte. Se explora un caso para formular hipótesis. Las hipótesis tienen esencialmente tres fuentes: la literatura existente, la imaginación sociológica y los estudios exploratorios.

- confirmando una teoría: probando una teoría sobre un caso particular para confirmar esta teoría, este tipo de estudio de caso no es muy útil, porque no es el hecho de que haya un caso que refleje una teoría existente que refuerce la teoría que hace que este sistema no sea muy útil.

- invalidar una teoría: esto es mucho más valioso, hay una teoría que se aplica en un caso específico, no tratamos de confirmar la teoría, pero para probar que no funciona, tratamos de invalidar una teoría. Esto nos lleva a pensar en la teoría, es algo importante para desarrollar una teoría.

- caso desviado: por qué un caso se desvía de la generalización, este caso es muy útil cuando se quiere refutar una teoría. Estamos buscando una situación que se desvía de una situación existente, el estudio de caso busca mostrar por qué este caso se desvía de la generalización.

Anexos[modifier | modifier le wikicode]

- Elisabeth Wood - An Insurgent Path to Democracy: Popular Mobilization, Economic Interests and Regime Transition in South Africa and El Salvador," Comparative Political Studies, October 2001. Translation published in Estudios Centroamericános, No. 641-2, 2002. url: http://cps.sagepub.com/content/34/8/862.short